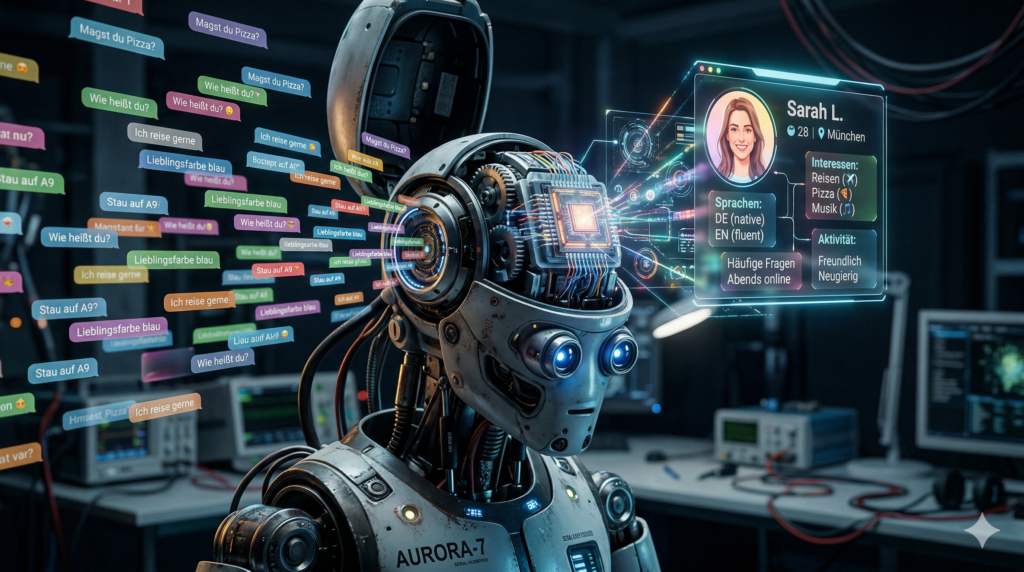

Die Gedächtnis- oder Memory-Funktion bei Cloud-KI-Anbietern ermöglicht es, dass ein KI-Chatbot sich über verschiedene Chats hinweg merkt, was der Nutzer mit ihm bespricht. Das ist in den letzten Monaten durch einen viralen Trend bekannter geworden, weil viele Menschen u.a. auf LinkedIn Bilder geteilt haben, die ChatGPT von ihnen erstellt hat, auf Basis des Wissens über die Nutzer. Der Prompt war ungefähr so: „Erstelle ein Bild von mir auf Basis von allem, was Du über mich weißt“.

Das ist natürlich ein netter kleiner Trick, und Bilder kann man auf Social-Media-Kanälen ja immer gut gebrauchen. Ich bin allerdings eher kritisch gegenüber dieser Funktion eingestellt, da sie auch Probleme mit sich bringt.

Direkt zu den passenden Einstellungen geht es hier:

Warum ich skeptisch bin?

Es gibt zwei Hauptpunkte, die ich bei der Gedächtnisfunktion kritisch sehe:

- Risiko der Anpassung der realen Inhalte/Realität an die Vorlieben des Nutzers (Filterblase)

- Die Erstellung eines Profils macht uns durch die KI manipulierbar und evtl. sogar kontrollierbar.

Beides birgt Probleme – aber eines nach dem anderen.

Problem 1: Anpassung der Inhalte

Wir kennen das von Google: jeder, der Cookies aktiviert hat, erhält ein anderes Suchergebnis, als wenn man Google im Inkognito-Fenster ohne jegliche Cookies nutzt. Das ist bereits eine Filterblase: Google zeigt die Inhalte an, die für uns auf Basis des vergangenen Suchverhaltens am ehesten zusagen. Bei einer KI ist das noch dramatischer. Durch die Gedächtnisfunktion wird alles, was wir jemals mit der KI besprochen haben, potentiell mit berücksichtigt. So wird die Information, die wir als Antwort erhalten, passgenauer zu unserem Profil. Es birgt aber auch die Gefahr, dass wir uns in eine Filterblase begeben, wenn die KI weiß, welche Inhalte/Quellen wir bevorzugen bzw. ungern als Basis der Antworten haben. Das möchte ich persönlich nicht – ich will immer die sachlich richtige Antwort, soweit das im Rahmen der Künstlichen Intelligenz mit ihrer Neigung zu Halluzinationen überhaupt möglich ist. Auch der eigentlich begrenzte Kontext-Speicher, den eine KI behalten kann, ist ein Problem hierbei.

Problem 2: Das Profil, das schon bereitliegt

Ich bin kein KI-Apokalyptiker, aber ich sehe durchaus Gefahren, die aus der Nutzung der allgegenwärtigen Künstlichen Intelligenz entstehen können. Die Gedächtnisfunktion führt dazu, dass aus den vielen Informationen, die ein Cloud-KI-Anbieter von uns sowieso hat, auch noch ein Profil erstellt wird. Das ist mir persönlich zu viel, insbesondere, weil ich wenig Nutzen darin sehe (s. Problem 1). Dementsprechend möchte ich vermeiden, dass irgendein KI-Anbieter ein vollständiges Profil von mir hat:

- meine Alltags-KI ist Gemini

- persönlichere Themen bearbeite ich auf Claude (Cloud-KI mit höchsten ethischen Standards)

- vertrauliche/sehr persönliche Themen und personenbezogene Daten bearbeite ich mit lokaler KI

Auch wenn es etwas gewagt klingt: sollte es zur KI-Apokalypse kommen, möchte ich gerne nicht zu der Gruppe gehören, die aufgrund der bereits vorhandenen Profile als erste unterjocht wird. 🤷🏻

Anleitung zum (De-)aktivieren Funktion

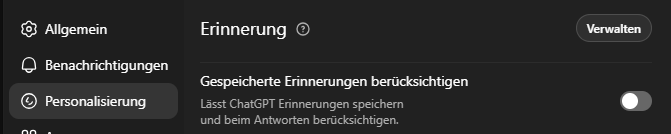

ChatGPT Gedächtnis-Funktion

Profilbild -> Einstellungen -> Personalisierung: „Gespeicherte Erinnerungen berücksichtigen“ kann deaktiviert werden.

Gemini

Bei Gemini gibt es diese Funktion nicht.

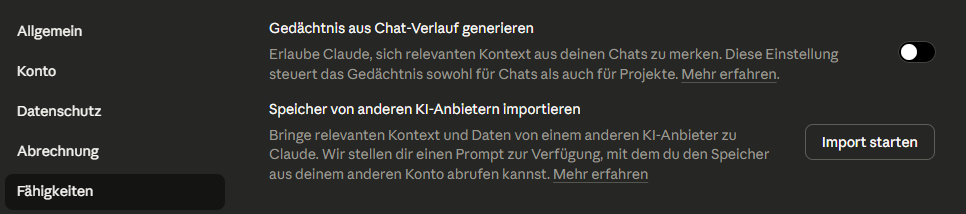

Claude Gedächtnis-Funktion

Profilbild -> Einstellungen -> Fähigkeiten: „Gedächtnis aus Chat-Verlauf generieren“ kann deaktiviert werden.

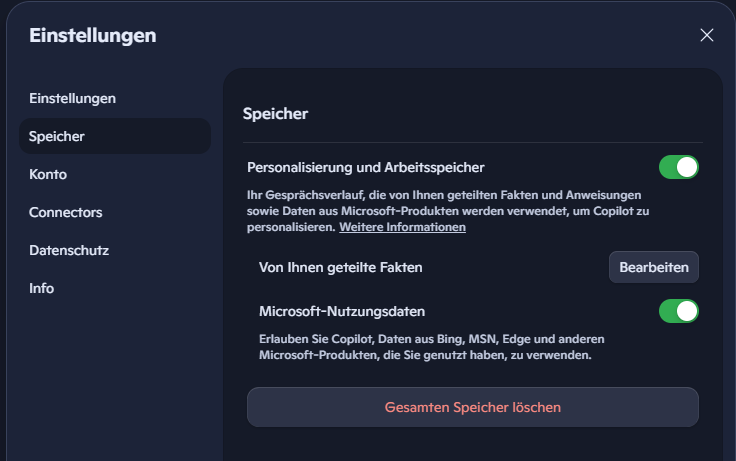

Copilot Gedächtnis-Funktion

Profilbild -> Einstellungen -> Speicher:

- „Personalisierung und Arbeitsspeicher“ kann deaktiviert werden.

- „Microsoft-Nutzungsdaten“ kann deaktiviert werden.

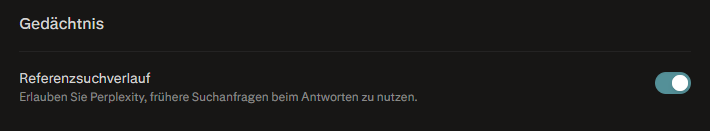

Perplexity Gedächtnis-Funktion

Profilbild -> Alle Einstellungen -> Präferenzen: „Referenzsuchverlauf“ kann deaktiviert werden.